文献情報

| タイトル | |

|---|---|

| SottoVoce: 超音波画像と深層学習による無発声音声インタラクション | |

| 著者 | |

|

|

| アブストラクト | |

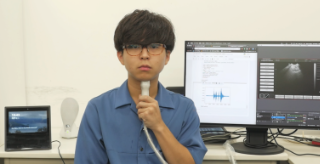

音声によって操作されるデジタル機器の利用可能性は急速に拡大している.しかし,音声インタフェースの使用状況は依然として制限されている.たとえば,公共の場で話すことは周囲の人に迷惑になり,秘密の情報を話すことができない.本研究では,超音波映像を用いて,利用者の無発生音声を検出するシステムを提案する.顎の下側に取り付けられた超音波イメージングプローブによって観察される口腔内の情報から,利用者が声帯を振動させずに発話した発声内容を認識する.超音波画像の系列から音響特徴を生成する2段階のニューラルネットモデルを提案する.提案モデルにより,合成したオーディオ信号が既存の無改造のスマートスピーカーを制御できることを確認した.これにより,人間とコンピュータが緊密に連携した種々のインタラクションが可能になり,新しいウェアラブル・コンピュータが構成可能になる。また、咽頭の障害、声帯機能障害、高齢による発声困難者に対して、声によるコミュニケーションを取り戻すための技術基盤を提供する.音声合成の精度を向上させるために,人間側も口の動きを調整できることが観察された.我々は,これを人間の脳と人工ニューラルネットが相互に協調する形態“Human-AI Integration”と呼ぶ. |

|

| 雑誌名 | |

| インタラクション2019論文集 © 情報処理学会 2019 |

|

| 論文ID | |

| INT19010 | |

| ページ | |

| 82-91 | |

| 発行日 | |

| 2019年2月27日 | |

| 発行所 | |

| 発行人 | 一般社団法人 情報処理学会 |

| 住所 | 〒101-0062 東京都千代田区神田駿河台一丁目5番地 化学会館4F |

| TEL. | 東京 (03) 3518-8374 (代表) |

| sig@ipsj.or.jp | |